Vibe coding ngày càng trở thành thuật ngữ then chốt khi các đội phát triển phần mềm tìm cách kết hợp trí tuệ nhân tạo để duy trì trạng thái flow và tối ưu hiệu suất. Trong bối cảnh chuyển đổi số mạnh mẽ tại Việt Nam, việc thiết kế một workflow AI-assisted không chỉ là tích hợp model mà còn là thay đổi cách làm việc, văn hóa và công cụ của đội ngũ. Bài viết này phân tích sâu về cách xây dựng môi trường "vibe coding" cho teams: từ lựa chọn mô hình, triển khai local LLMs, tích hợp RAG cho kiến thức nội bộ, đến quy trình MLOps và bảo mật mã. Cụ thể, chúng ta sẽ trình bày các pattern kiến trúc, ví dụ mã thực tế, checklist triển khai và bài học từ thực tế để giúp thực thi thành công tại doanh nghiệp.

Vibe coding là gì và tại sao nó quan trọng

Định nghĩa và bản chất của vibe coding

Vibe coding là một phương thức phát triển phần mềm tập trung vào trạng thái tư duy của lập trình viên—giữ cho họ ở trong flow lâu hơn bằng cách giảm friction trong công việc. Một hệ thống vibe coding thường kết hợp AI-assisted tooling: từ gợi ý mã, tự động tạo unit tests, tới hỗ trợ giải thích và truy xuất kiến thức nội bộ. Theo đó, mục tiêu là tối thiểu hoá ngắt quãng, tối ưu hoá luồng thông tin và tăng tốc lặp tính năng. Đặc biệt, khi team chuyển sang remote hoặc hybrid, việc duy trì vibe coding càng trở nên thiết yếu để giảm mất năng suất do ngắt kết nối.

Lợi ích cho đội ngũ phát triển

Áp dụng vibe coding giúp tăng năng suất, giảm thời gian debug và cải thiện chất lượng mã thông qua gợi ý code context-aware và kiểm thử tự động. Hơn nữa, AI có thể đóng vai trò như một pair programmer 24/7, hỗ trợ cả junior lẫn senior engineers khi cần giải thích pattern hay refactor. Ngoài ra, khi tích hợp RAG, đội ngũ có thể truy xuất nhanh tài liệu nội bộ, ticket và kiến trúc hệ thống để đưa ra quyết định chính xác hơn. Cụ thể, nhiều tổ chức báo cáo giảm 20-40% thời gian sửa bug ở các module quan trọng khi áp dụng workflow AI hợp lý.

Rủi ro và giới hạn cần lưu ý

Mặc dù có nhiều lợi ích, vibe coding cũng mang theo rủi ro: lệ thuộc vào gợi ý AI có thể dẫn tới kỹ thuật kém nếu không có code review chặt chẽ. Ngoài ra, vấn đề bảo mật dữ liệu khi gửi code nội bộ lên cloud LLMs cần được quản trị cẩn trọng, đặc biệt với IP nhạy cảm. Do đó, doanh nghiệp cần kết hợp policy, local models và encryption để giảm nguy cơ lộ lọt. Cuối cùng, không phải mọi công việc đều phù hợp để tự động—các quyết định kiến trúc phức tạp vẫn yêu cầu thảo luận con người.

Thiết kế workflow AI-assisted cho teams

Kiến trúc tổng thể: Local LLM, RAG và CI/CD

Một workflow tiêu biểu kết hợp ba lớp: local LLM hoặc private LLM để bảo mật, RAG (Retrieval-Augmented Generation) để truy xuất kiến thức nội bộ, và pipeline CI/CD để tự động hoá kiểm thử và triển khai. Lớp RAG thường sử dụng embeddings và vector store để map ngữ cảnh từ ticket, docs và codebase. Ngoài ra, tích hợp hooks vào hệ thống CI (ví dụ pre-commit hoặc PR checks) giúp kiểm soát chất lượng đầu vào cho AI. Quan trọng là kiến trúc phải cho phép rollback và audit để đảm bảo an toàn khi AI gợi ý thay đổi mã tự động.

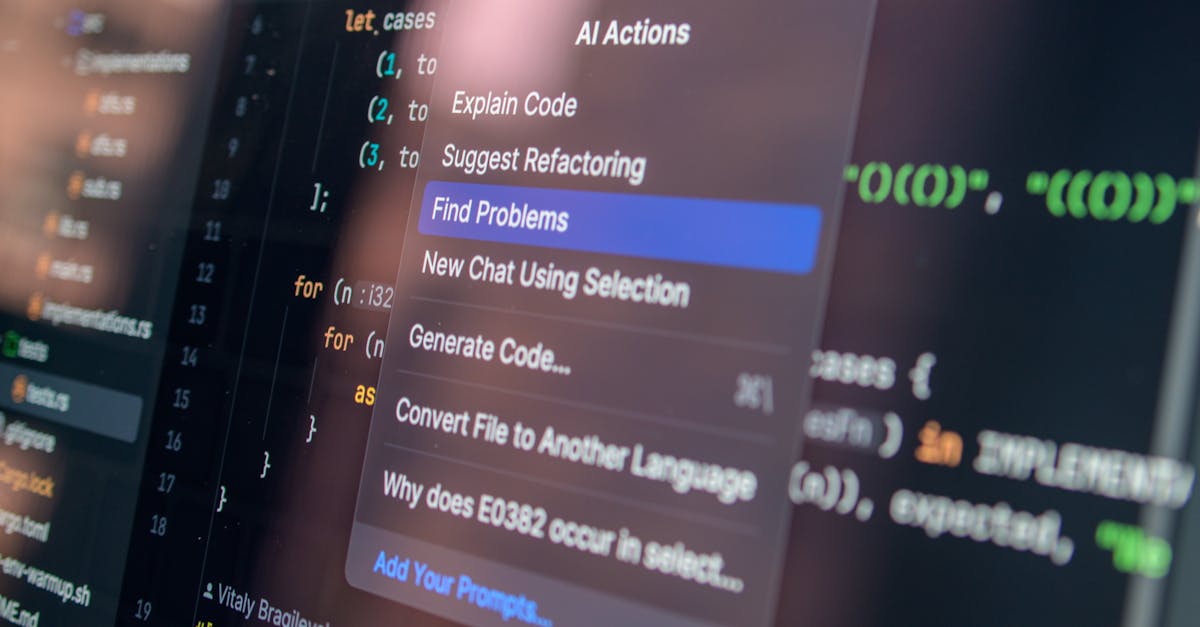

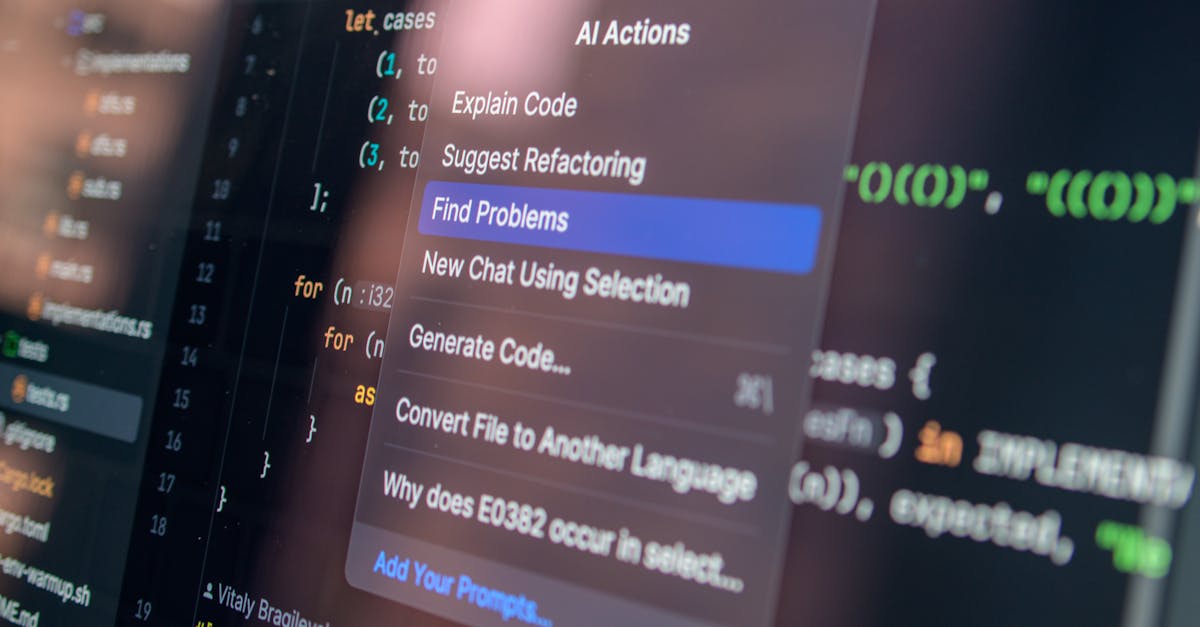

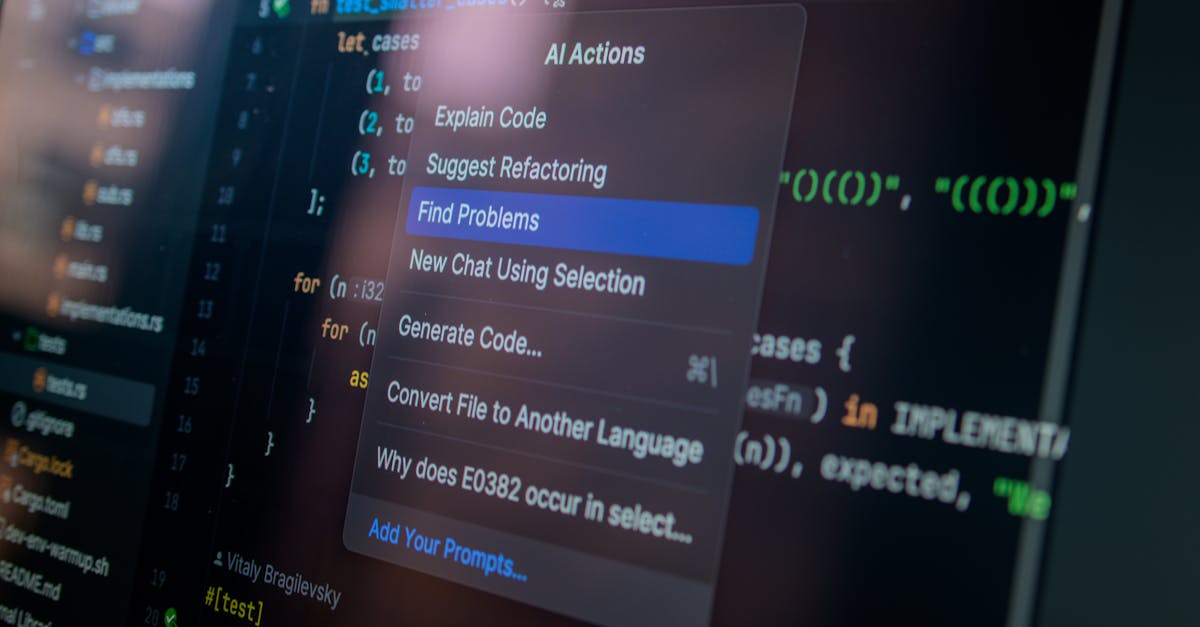

Pattern tích hợp vào IDE và code review

Để thực tế hóa vibe coding, tích hợp AI vào IDE (VSCode, JetBrains) thông qua extension hoặc LSP là bước đầu quan trọng. Extension nên hỗ trợ code completion, explain code, generate tests, và refactor suggestions theo ngữ cảnh repo. Hơn nữa, AI-assistant cần được gắn vào quy trình code review dưới dạng comment suggestions thay vì commit tự động; điều này giữ quyền kiểm soát cho engineer. Ví dụ, policy có thể yêu cầu mọi suggestion lớn của AI phải có approval của ít nhất một reviewer con người.

Quy trình triển khai cho teams: pilot, scale, govern

Quy trình triển khai hiệu quả gồm ba giai đoạn: pilot small team, iterate integration với feedback, và scale ra toàn tổ chức. Trong giai đoạn pilot, chọn module ít rủi ro để test RAG và local LLM, thu thập metrics như lead time, PR size và bug rate. Sau khi validating, mở rộng tích hợp và bổ sung training cho developers để hiểu cách dùng AI đúng. Cuối cùng, áp dụng governance: policy, logging, và privacy controls để quản lý rủi ro khi scale.

Thực tiễn kỹ thuật: ví dụ mã và pattern

Ví dụ 1: Tích hợp local LLM qua REST cho extension

Dưới đây là ví dụ Node.js cho một extension IDE gọi local LLM qua REST API để lấy gợi ý code. Mẫu này minh hoạ cách client gửi context file và cursor position, và server trả về snippet gợi ý. Mẫu phù hợp với các tổ chức muốn giữ dữ liệu nội bộ trên hạ tầng riêng, tránh rò rỉ ra cloud public. Hơn nữa, pattern này có thể mở rộng bằng cách thêm RAG pre-processing trước khi hỏi LLM.

// server.js - simple local LLM proxy (Express)

const express = require('express');

const bodyParser = require('body-parser');

const axios = require('axios');

const app = express();

app.use(bodyParser.json());

app.post('/api/complete', async (req, res) => {

const { context, cursor } = req.body;

// Call to local LLM endpoint (example)

const response = await axios.post('http://localhost:8000/v1/generate', { prompt: context, max_tokens: 150 });

return res.json({ suggestion: response.data.text });

});

app.listen(3000, () => console.log('Local LLM proxy running on 3000'));

Mã này cho thấy tập trung vào latency và bảo mật: proxy chạy nội bộ, mã không gửi code ra public cloud. Ngoài ra, có thể áp dụng rate limiting và auth header để kiểm soát truy cập. Cụ thể, doanh nghiệp nên thêm encryption in transit và audit logs để lưu trữ truy vấn LLM khi cần forensics. Đây là pattern cơ bản, nhưng đủ mạnh khi kết hợp với RAG để tăng độ chính xác của gợi ý.

Ví dụ 2: RAG cho truy xuất kiến thức nội bộ

RAG (Retrieval-Augmented Generation) giúp bổ sung ngữ cảnh từ docs và ticket khi hỏi LLM, giảm hallucination và nâng cao tính chính xác. Workflow thường gồm indexing docs bằng embeddings, lưu trữ trong vector store, và khi có truy vấn, truy xuất top-k docs rồi gửi kèm prompt cho LLM. Điều này đặc biệt hữu ích khi dự án có nhiều domain-specific knowledge không có trong model. Hơn nữa, RAG cho phép kiểm soát nguồn thông tin, ghi nhãn và audit từng tài liệu được dùng cho trả lời.

# pseudo-code: retrieve top docs then call LLM

from vectorstore import VectorStore

from llm_client import LLMPredictor

vs = VectorStore('company-vector-db')

llm = LLMPredictor(endpoint='http://localhost:8000')

query = "Why does payment service timeout on retries?"

top_docs = vs.search(query, k=5)

context = "\n\n".join([d.text for d in top_docs])

prompt = f"Context:\n{context}\n\nQuestion:\n{query}\nAnswer:"

answer = llm.generate(prompt)

print(answer)

Khi triển khai RAG, cần chú ý preprocessing tài liệu: loại bỏ thông tin nhạy cảm, chuẩn hoá định dạng và cập nhật index định kỳ. Ngoài ra, logging từng version của document index giúp truy xuất nguồn gốc khi model tạo ra câu trả lời sai. Theo đó, RAG là thành phần then chốt để biến AI từ một blackbox thành một công cụ đáng tin cậy cho developer workflows.

Văn hoá, governance và KPI cho vibe coding

Bảo mật, quyền riêng tư và compliance

Khi áp dụng AI vào quy trình phát triển, bảo mật dữ liệu và tuân thủ luật pháp trở thành ưu tiên hàng đầu. Doanh nghiệp cần phân loại dữ liệu (sensitive vs non-sensitive), áp dụng encryption at rest và in transit, và thiết lập policy cấm gửi secret hoặc code nhạy cảm tới public APIs. Ngoài ra, audit trails cần ghi lại các truy vấn LLM và suggestions được chấp nhận để phục vụ điều tra khi cần. Đặc biệt, với các ngành regulated như tài chính hay y tế, yêu cầu compliance phải được tích hợp xuyên suốt thiết kế hệ thống.

Đo lường hiệu quả: KPIs phù hợp

Để đánh giá thành công của vibe coding, cần đo những KPIs thực tế: lead time giảm bao nhiêu, PR merge time, bug rate sau deploy, và developer satisfaction. Hơn nữa, metric usage của AI (bao nhiêu suggestions được chấp nhận) cung cấp insight về độ hữu dụng của tooling. Ngoài ra, theo dõi false positive của AI (gợi ý sai) giúp cải thiện bộ lọc trước khi suggestions tới developer. Cụ thể, đặt mục tiêu giảm 15-25% lead time trong 3-6 tháng là khả thi nếu triển khai đúng cách.

Đào tạo và thay đổi văn hoá

Vibe coding không thể chỉ là công nghệ; nó yêu cầu thay đổi văn hoá: khuyến khích thử nghiệm, document hoá best practices và training liên tục cho đội ngũ. Các buổi workshop hands-on về cách dùng local LLM, cách viết prompt hiệu quả và cách review suggestion là cần thiết. Ngoài ra, xây dựng cộng đồng nội bộ (internal champions) giúp lan toả kỹ năng và kinh nghiệm. Theo đó, sự chấp nhận của con người mới là yếu tố quyết định lâu dài.

Checklist triển khai nhanh cho doanh nghiệp

Các bước ưu tiên để bắt đầu

1. Pilot small: chọn 1-2 module non-critical để test RAG và local LLM. 2. Setup local LLM hoặc private cloud model để bảo mật code. 3. Tích hợp vào IDE và CI/CD với guardrails như approval và logs. 4. Đo metrics và iterate based on feedback. 5. Mở rộng dần kèm governance. Những bước này tạo một lộ trình thực tế và giảm rủi ro khi scale.

Checklist kỹ thuật ngắn

- Thiết lập vector store và index docs nội bộ. - Khởi tạo local LLM hoặc private endpoint. - Tích hợp extension IDE, hooks CI và PR bot. - Thực hiện data classification và encryption. - Thiết lập logging, audit và policy. Thực hiện những bước này giúp đảm bảo hệ thống có thể vận hành an toàn và có thể mở rộng.

Liên kết với dịch vụ của Haven.vn

Nếu bạn cần dịch vụ triển khai workflow AI-assisted, dịch vụ Phát Triển Phần Mềm của Haven.vn có thể hỗ trợ tích hợp CI/CD, extension IDE và API gateway. Ngoài ra, cho các giải pháp AI chuyên sâu, Giải Pháp AI Agent và RAG & Chatbot Development là lựa chọn phù hợp để xây dựng Vibe Coding cho doanh nghiệp. Hơn nữa, đội ngũ của chúng tôi có kinh nghiệm triển khai local LLM và governance cho các tổ chức ở Việt Nam.

Kết luận và kêu gọi hành động

Tóm lại, vibe coding là sự giao thoa giữa con người, quy trình và AI—một nền tảng để tăng năng suất và cải thiện chất lượng phần mềm khi triển khai đúng cách. Đặc biệt, với các công ty Việt Nam đang đẩy mạnh chuyển đổi số, thiết kế workflow AI-assisted là bước chiến lược để giữ lợi thế cạnh tranh. Nếu bạn muốn bắt đầu pilot hoặc cần tư vấn kiến trúc, hãy liên hệ Haven.vn để được đánh giá miễn phí và roadmap chi tiết. Đăng ký dịch vụ để chúng tôi cùng bạn xây dựng một môi trường làm việc nơi developer luôn trong trạng thái flow và tạo ra giá trị nhanh hơn.